Более двух лет назад поступила информация, что человек безнадежно уступил компьютеру в одном достаточно интеллектуальном и достаточно прекрасно оплачиваемом занятии. Нет-нет, не в передвижении фигурок по черно-белым клеточкам, в том месте все свершилось большое количество раньше. А два с маленьким года назад компьютер от IBM обучился диагностировать легочную онкологию лучше, чем люди – с точностью 90% против 50% у самых умелых докторов. Об этом, ну и о вероятных последствиях, мы поведали в колонке «Дети Ватсона: Как кремниевый онколог приступил к работе над исцелением человека и какие конкретно ещё профессии может освоить ИИ…».

И в случае если на данный момент не полениться, забрать да почитать комментарии к той давнишней статье, то мы заметим, что у читателей срабатывала защитная реакция. Из серии того, что, дескать, Watson никакой не врач, а простая – хоть и громадная и быстродействующая – база знаний. Наподобие старой экспертной совокупности MYCIN, написанной еще в начале семидесятых на языке LISP – эксперты Стэнфордского университета создали ее для диагностики бактериальных зараз. Позднее на ее базе показалась пульмонологическая PUFF…

Другими словами – никакого интеллекта. Имеется факты, имеется правила вывода. Действительно, сейчас они почерпнуты из для того чтобы массива историй заболеваний, что не сможет обозреть ни один самый работоспособный и самый умелый протеиновый медик. Что формирует увлекательнейшую коллизию – это во времена MYCIN возможно было годами дискутировать довольно ее немногочисленных и обозримых правил вывода. Сейчас таковой фокус не пройдет – правила вывода Watson-а столь бессчётны, что смогут быть признаны только страховой компанией с их огромными архивами. Каковые и оценили столь высоко эффективность кремниевого онколога.

Но остаются все-таки такие вещи, как интуиция. Творчество, на которое сохраняли надежду комментаторы статьи двухлетней давности. Неформализованная, а вероятно и неформализуемая в принципе интуиция, вырабатываемая на опыте и отображающая во многих случаях закономерности настоящего мира лучше, чем чисто формальные правила. В конкретной области легочной онкологии врач Watson неподражаем. Но в то время, когда он сможет сравниться с врачом Хаусом, вымышленным, но непревзойденным экспертом дифференциального диагноза.

Глубочайше знание которым людской натуры воплотилось в лаконичных словах «Все лгут!»… Весьма полезным для любого, кто по роду занятий имеет дело с людьми. А также – для ИИ. Давайте обратим внимание – так как тест Тьюринга, тест на «разумность», по собственной сути есть тестом на умение лгать. Лгать так умело, дабы появляться талантливым выдать себя «за собственного» в свора узконосых мартышек. Критерием интеллекта выяснилось выбрано не умение решать интегральные уравнения, а свойство лгать – занимательная черта людской цивилизации…

Так что ИскИнам от IBM, тем самым Ватсонам, для их деятельности в самых разных областях потребовалось получше овладеть людской общением. И такую возможность сейчас дает разработка глубокого обучения, deep-learning, дешёвые разработчикам приложений на базе Watson через облако, поддерживающее интерфейс программирования приложений, application programming interface, API.

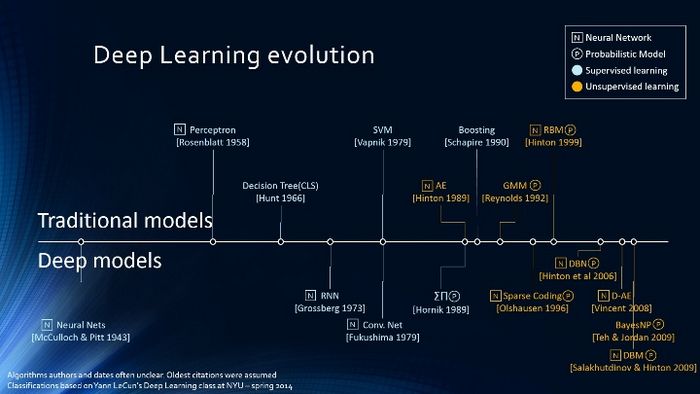

Ватсон, превзошедший в 2013 году протеиновых докторов, объединился с глубоким обучением, прорывной разработкой 2013-го года. (Deep Learning) Обучается в этом случае не школьник либо студент, а нейросеть. Ну а глубинность пребывает в том, что «обучению», формированию весовых коэффициентов в устройстве, моделирующем нейрон – причем схемотехника и разработка этого устройства не серьёзна – подвергаются внутренние слои нейросети громадной размерности.

Глубокое обучение – от МакКаллоха до наших дней…

Ну, «внутренние» –это достаточно условно, как и «громадная» размерность. Более совершенно верно возможно сказать, что это те параметры нейросети, на которых не работает способ обратного распространения неточности. Когда-то Мартин Гарднер обрисовывал самообучающуюся машину из спичечных коробков с фишками, которая игралась в крестики-нолики. Самообучение ее обуславливалось тем, что по окончании проигрыша фишки, ведущие к проигранной партии, изымались из корок и выкидывались. (Эдакий аналог когтей и клыков эволюции, выписывавших премию Дарвина носителю малополезного кода…)

Это-то и было прообразом способа обратного распространения неточности. При котором осуществляется распространении сигналов неточности от выходов сети к её входам, в направлении, обратном прямому распространению сигналов как и всегда работы, к примеру, персептрона. В принципе это примененный к настройке нейросети один из способов оптимизации, в частности – градиентного спуска. С сохранением характерного недочёта – резким ростом времени работы на громадных размерностях. Что и затрудняло обучение крупноразмерных нейросетей.

Но за последний дюжина лет показались и интенсивно развивались методы, разрешающие обучать нейросети громадных размеров на сложных комплектах данных за приемлемое время. Совокупность этих методик и алгоритмов обучения и стала называться deep-learning. Интересующимся порекомендуем превосходную и неизменно дописываемую сетевую бесплатную книгу Neural Networks and Deep Learning, являющуюся общедоступным введением в проблему.

Ну а остальным поясним, что технологии глубокого обучения на данный момент разрешают заметно повысить сложность задач, решаемых нейросетями. Наподобие пресловутого распознавания котиков… Доступность замечательнейших параллельных вычислительных мощностей по приемлемым стоимостям – благодарю разработчикам и любителям видеоигр видеоускорителей, повлиявшим на отрасль в целом – подвигло такие гиганты ИТ-мира, как Google и Facebook прибегнуть к услугам ведущих экспертов по глубокому обучению.

Ну а сейчас к ним присоединяется и IBM – IBM Pushes Deep Learning with a Watson Upgrade. Сейчас технологии глубокого обучения интенсивно внедряются в Ватсона. Сперва – в его лингвистические приложения, воображающие услуги машинного перевода, вокализации текстов и распознавания речи. Позже они будут использованы и для работы с другими не хорошо структурированными массивами данных.

Вправду, нейросети глубокого обучения смогут, ничего не зная об окружающем мире, обучиться бихевиористически отражать его закономерности. Ну, приблизительно как попугай произносит ругательства, иногда уместные… Объединение их с другими способами – ну, хотя бы с классическими базами знаний, разрешит радикально повысить эффективность ИскИнов. И вот тут вылезает занимательнейшая неприятность…

Нейросеть, в ходе собственного глубокого обучения, обретает то, что с некоей степенью аналогии возможно будет назвать «интуицией». В ней нет правил и фактов, совершенно верно отображающих те либо иные закономерности мира, но однако, благодаря обучению на громадном комплекте данных, она ведет себя так, словно бы они у нее имеется. (Само собой разумеется, в случае если использованные при обучении эти были представительны…) И вот тут-то начнется самое забавное…

Потому, что отсутствуют факты и формализованные правила, то автомобили начнут обретать то, что возможно назвать «характером». А он у Хауса был скверным – бездельничал, лгал, “сидел” на викадине. Но альтернативы ему не было… И альтернативы врачу Ватсону не будет ни при каких обстоятельствах – человеку столько разрешённых не прочитать, и в голове не удержать. И это – формализованных данных. А к ним вот-вот добавятся коэффициенты, выработанные при глубоком обучении. И не окажется ли так, что людям в скором будущем нужно будет мириться с нехорошим характером собственных же созданий?